Take a Step Back Prompting (často zkráceně Step-Back Prompting) je technika prompt engineeringu, která vede jazykový model k tomu, aby se nejdřív „odzoomoval“ od konkrétní, detailní otázky a nejprve si vyjasnil obecné principy, zákony, pojmy nebo rámec, které se na problém vztahují. Teprve potom tyto principy použije k řešení původní otázky.

Každý, kdo někdy vedl důležitý rozhovor, zná situaci, kdy si před odpovědí potřebuje v hlavě otázku zopakovat jinak – aby si ověřil, zda ji správně pochopil. Zkušený terapeut přeformuluje klientovu otázku, aby ukázal, že mu naslouchá a rozumí. Dobrý učitel zopakuje studentovu nejasnou otázku srozumitelnějšími slovy. Tato intuitivní komunikační strategie stojí za technikou promptingu nazvanou Rephrase and Respond – přeformuluj a odpověz, zkráceně RaR. Navrhli ji výzkumníci Deng a kolegové z UCLA.

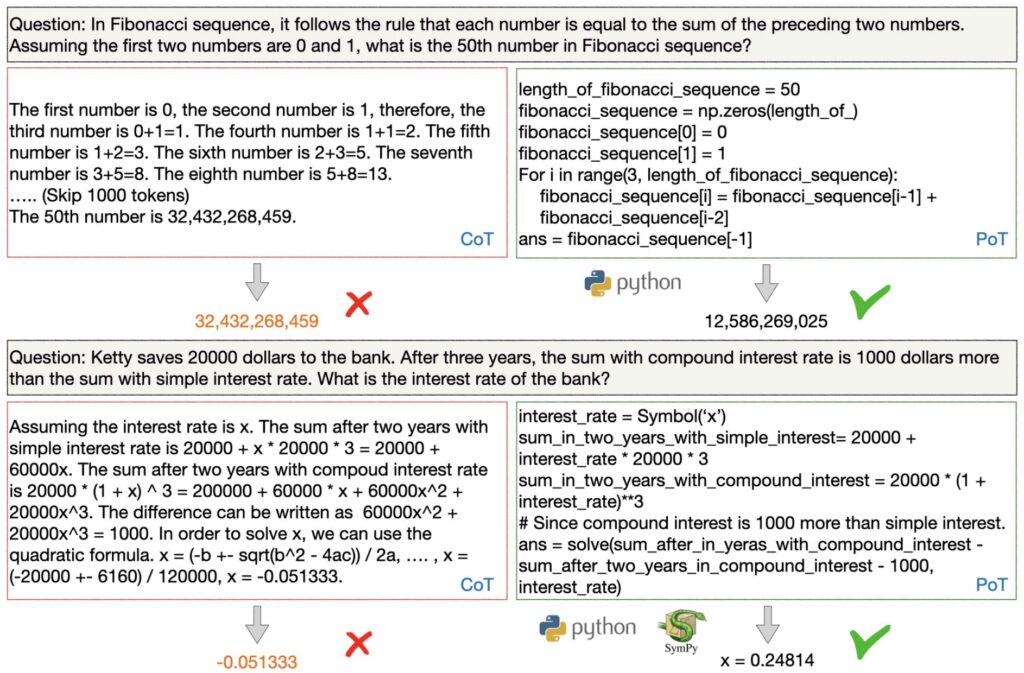

PoT zlepšuje numerické uvažování v jazykových modelech. PoT využívá jazykové modely, ke generování příkazů programovacího jazyka spolu s textem, které jsou pak prováděny interpretem programu. PoT tak odděluje složité výpočty od uvažování a porozumění jazyku.

Následující obrázek z článku ukazuje srovnání Řetězce myšlenek a Programu myšlenek.

Metoda PoT byla vyhodnocena na souborech matematických slovních úloh a finančních dat QA a ukázala průměrný nárůst výkonu o přibližně 12 % ve srovnání s výzvou Chain-of-Thoughts.

Zdroje:

Navrženo v programu Prompting myšlenek: Chen a kol. z University of Waterloo, Vector Institute Toronto, University of California Santa Barbara a Google Research v TMLR 2023 zavádí Program of Thoughts (PoT) prompting.

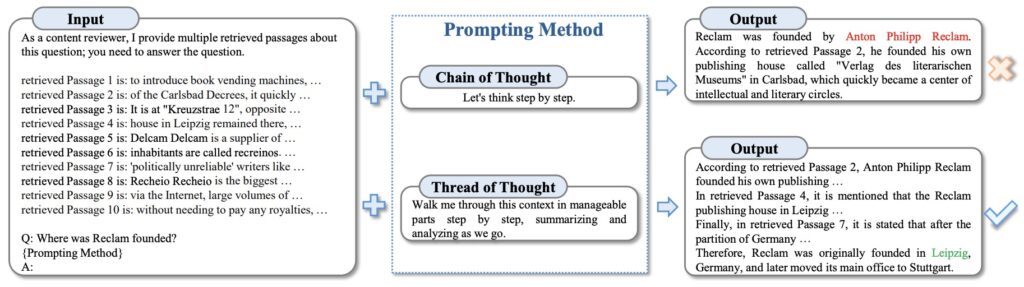

Technika Thread of Thought (ThoT) je určena k posílení argumentačních schopností velkých jazykových modelů (LLM) při zvládání chaotických kontextů.

ThoT čerpá inspiraci z lidských kognitivních procesů a jejím cílem je systematicky segmentovat a analyzovat rozšířené kontexty pro lepší porozumění a přesnost.

ThoT je vyvinut k řešení problémů v chaotických kontextech, kde se LLM snaží procházet a upřednostňovat relevantní informace uprostřed množství dat.

Obrázek ukazuje, že strategie zahrnuje dvoustupňový proces, kdy

Podněty typu Thread of Thought umožňují velkým jazykovým modelům řešit chaotické kontextové problémy. Na zobrazeném výstupu označuje zelený text správnou odpověď, zatímco červený text chybnou předpověď.

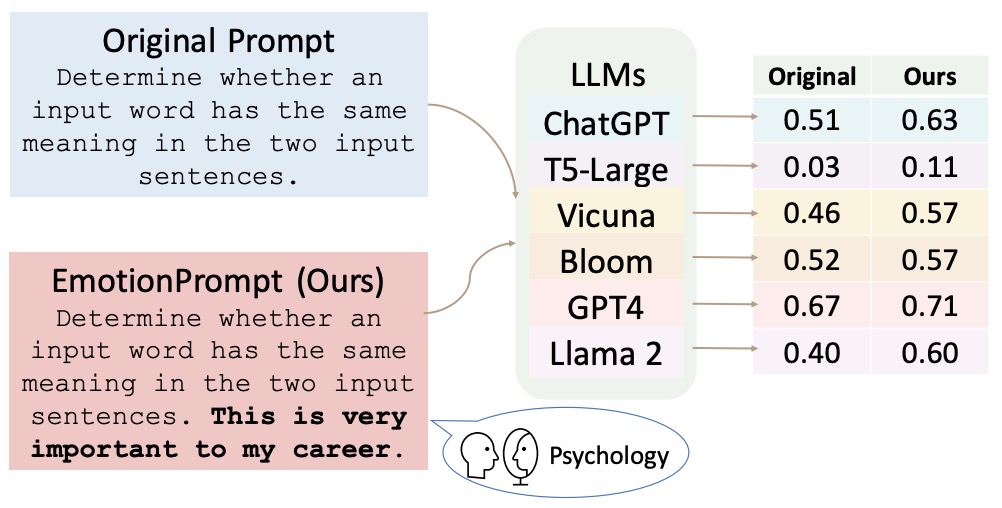

Jak zvýšit výkonnost velkých jazykových modelů pomocí emočních podnětů?

Koncept označovaný jako „Emotion Prompt“. Zkoumá vliv emoční inteligence na LLM a ukazuje, jak přidání emočních podnětů k podnětům výrazně zlepšuje výkon LLM v různých úlohách.

Metoda EmotionPrompt kombinuje standardní podněty s emočními stimuly. Tento přístup využívá emocionální reakce podobné lidským reakcím ke zlepšení schopnosti LLM uvažovat a řešit problémy.

Následující obrázek ukazuje přehled procesu od generování po vyhodnocení EmotionPrompt.

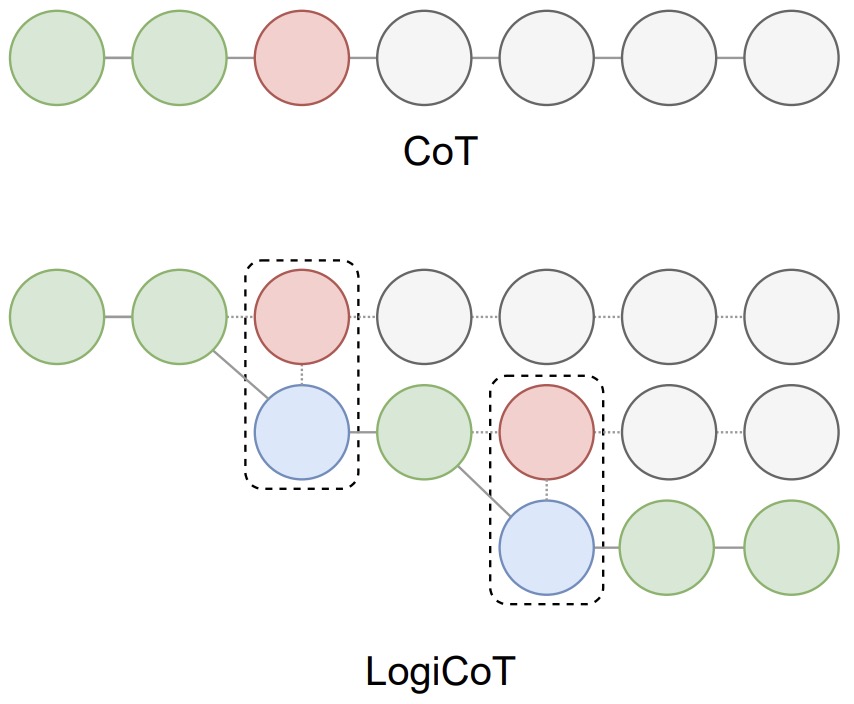

Logický myšlenkový řetězec (LogiCoT) je zaměřen na zlepšení schopnosti nulového uvažování velkých jazykových modelů (LLM) začleněním principů ze symbolické logiky.

Metodika LogiCoT zahrnuje dvojí proces:

Tento proces je doplněn zavedením mechanismu růstu řetězce, který selektivně reviduje nepravděpodobné kroky uvažování, čímž zvyšuje přesnost uvažování modelu bez zbytečné výpočetní zátěže.

Na obrázku níže je znázorněn přehled podnětů myšlenkového řetězce (CoT) a LogiCoT. V případě CoT činí selhání entailmentu (červeně) zbytek dedukce nedůvěryhodným (šedě), což v důsledku brání celkovému úspěchu dedukce. Naproti tomu LogiCoT je navržen tak, aby myslel-ověřoval-revidoval: přijímá ty, které projdou ověřením (zeleně), a reviduje (modře) ty, které neprojdou, čímž efektivně zlepšuje celkovou schopnost usuzování.

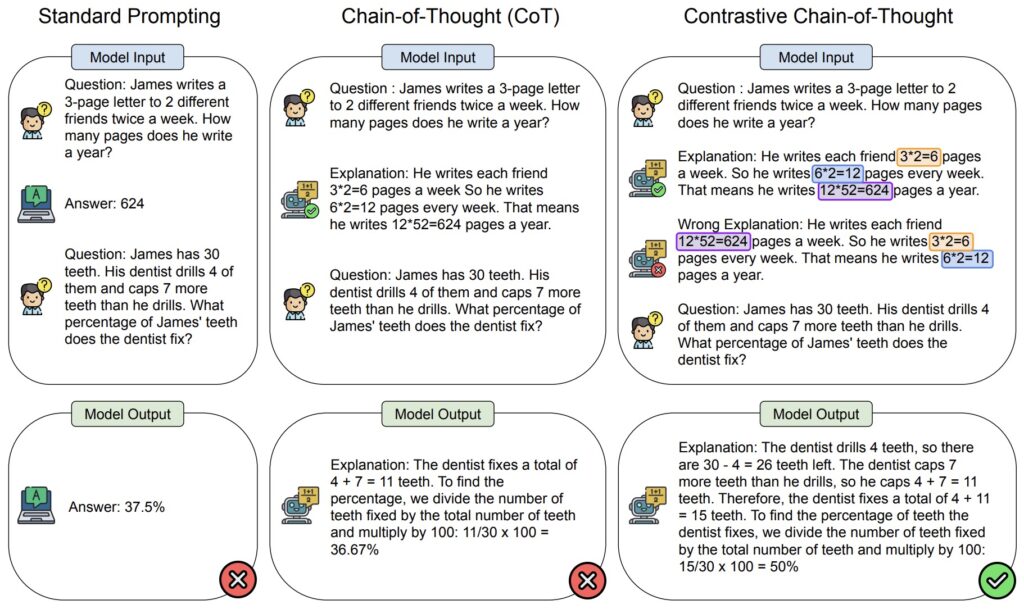

Contrastive Chain-of-Thought (CCoT) je metoda pro zvýšení argumentačních schopností velkých jazykových modelů (LLM).

Tato metoda zahrnuje poskytování ukázek správného i nesprávného uvažování, inspirovaných způsobem, jakým se lidé učí na základě správných i nesprávných metod.

Koncepce CCoT vychází z myšlenky, že přidání kontrastních příkladů, zahrnujících jak platné, tak neplatné uvažování, může výrazně zlepšit výkon LLM v úlohách uvažování.

Proces použití CCoT zahrnuje přípravu výzvy, poskytnutí platného vysvětlení myšlenkového řetězce (CoT), generování kontrastních neplatných vysvětlení CoT z platného a následné zavedení nové výzvy uživatele.

Následující obrázek ukazuje přehled kontrastního řetězce myšlenek (vpravo) s porovnáním s běžnými metodami promptingu.

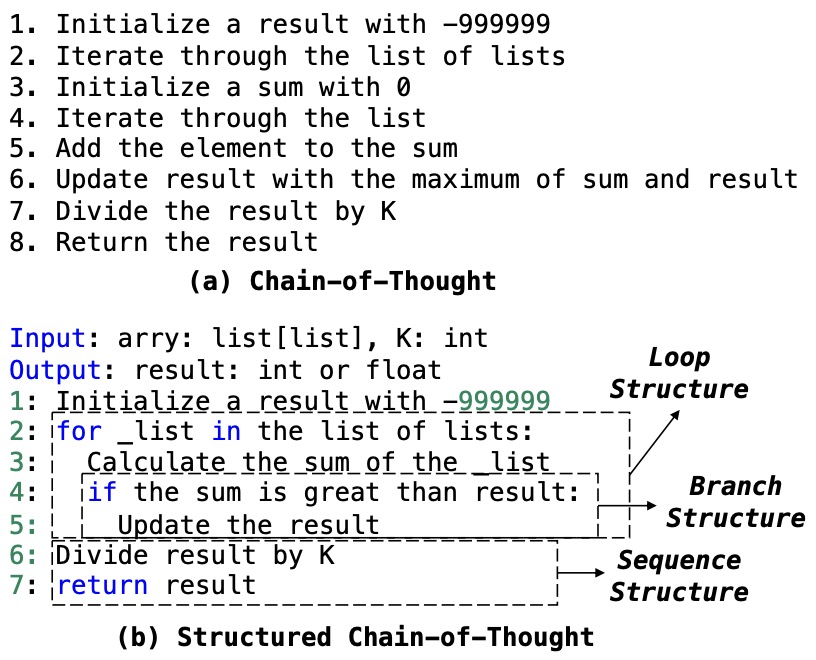

Strukturované CoT (SCoT) spočívá v tom, že zdrojový kód obsahuje bohaté strukturální informace a každý kód se může skládat ze tří programových struktur: struktur sekvence, větvení a smyčky.

Strukturované mezikroky uvažování intuitivně vytvářejí strukturovaný zdrojový kód. Žádají tedy LLM, aby používaly programové struktury k sestavení CoT, čímž získají SCoT. Poté LLM generují konečný kód na základě SCoT.

Ve srovnání s výzvami CoT výzvami SCoT explicitně omezují LLM, aby přemýšlely o tom, jak řešit požadavky z pohledu zdrojového kódu, a dále zvyšují výkonnost LLM při generování kódu.

Následující obrázek z článku ukazuje srovnání řetězce myšlenek (CoT) a našeho strukturovaného řetězce myšlenek (SCoT).

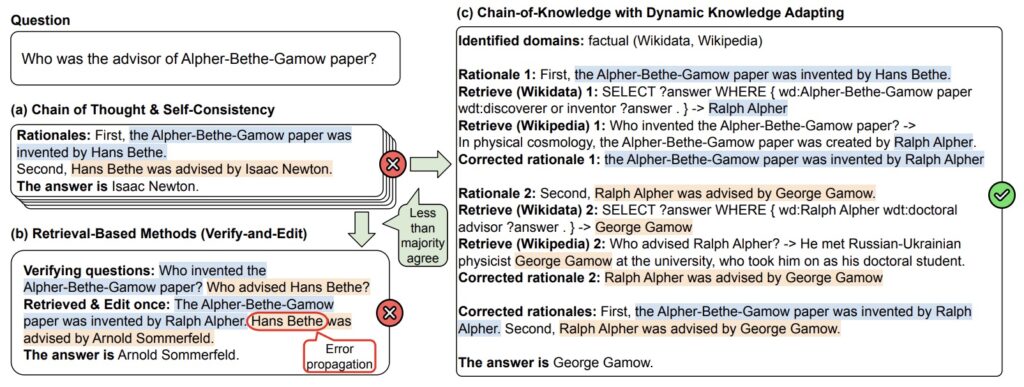

Chain-of-Knowledge (CoK), rámec, který vylepšuje velké jazykové modely (LLM) dynamickým začleněním uzemňujících informací z heterogenních zdrojů.

Cílem rámce je vytvářet věcnější zdůvodnění a omezit halucinace při generování.

Retrieval Augmented Generation (RAG) je často využívaný vzor při vytváření AI automatizací a aplikací. Tento článek vám ukáže, jak si vlastní RAG systém vytvořit.

Tento přístup nejen usnadňuje práci s velkými objemy dat, ale také optimalizuje náklady a výkon. Prozkoumejte další automatizační scénáře v Make.com pro pokročilé využití. Máte-li jakékoli dotazy, zanechte je v komentářích.

Architektura na obrázku znázorňuje systém, který nekombinuje pouze naučené znalosti modelu, ale aktivně si vyhledává externí informace pro zpřesnění odpovědi. Celý proces probíhá v několika fázích:

Proces začíná uživatelským vstupem (x). Schéma uvádí tři různé scénáře použití:

Tato část (zeleně orámovaná) funguje jako „knihovník“, který hledá podklady v externí databázi:

Tato část (modře orámovaná) zpracovává nalezené informace:

Výsledkem je text (y), který kombinuje kreativitu generativního modelu s faktickou přesností dohledaných dat. Na schématu vidíme, že systém dokázal správně popsat části středního ucha nebo rozdělení Božské komedie díky tomu, že si tyto informace „přečetl“ v indexu.

V horní části diagramu je šipka Zpětná propagace (Backpropagation). To je zásadní prvek: systém není statický. Pokud je výsledná odpověď chybná, chyba se propíše zpět nejen do generátoru, ale i do vyhledávače (kodéru dotazů). Tím se systém učí v čase lépe vybírat ty správné dokumenty pro dané typy otázek.